新电车问题 无人驾驶面对事故该如何选择

标签:麻省理工 无人驾驶 2017-01-20 09:06:39

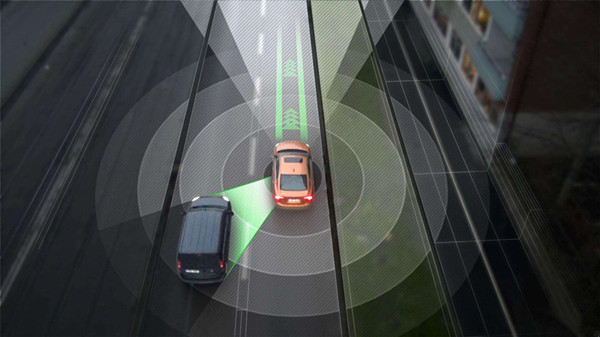

当无人驾驶汽车遇到无法避免的事故的时候,它会做出怎样的选择?(是保护车主还是避开路人)。麻省理工学院(MIT)的研究人员希望通过人们在"道德机器"上的回答来研究这个问题。这个问题就好像当年著名的"电车问题"。

那么电车问题具体是什么呢?首先,假想有一个疯子,他把五个无辜的人绑在电车轨道上,而此时一辆失控的电车正在冲过来,并且很快就要压到他们。现在有一个拉杆,只要你拉动这个拉杆就可以改变电车的行驶路线。但是问题在于,在另一条轨道上也绑着一个人。综合上述情况,你是否会拉动这个拉杆?现在你面临两种选择,一是什么也不做,让五个无辜的人被电车压死;二是拉动拉杆,电车就开到另一条轨道上,但是这样另一条轨道上的那个人就会死亡。

以上就是电车问题的全部内容了,问题通俗易懂,但是它的答案却充满了争议。那么回到MIT的那个无人驾驶汽车遇到无法避免的事故应该如何选择的问题,虽然这样的事故发生几率很小,但是在发生时的选择同样值得商讨。比如说,在逃犯与无辜的人之间应如何选择;人的生命与动物的生命之间应如何选择;男性与女性之间应如何选择;年轻与年老之间应如何选择等等问题,这些都没有正确的答案,但其在决定人类认为无人驾驶汽车应该如何应对事故中的伦理困境时有一定作用。麻省理工的"道德机器"算法就是希望能够在这些极小概率发生的事件中能够选择一个相对符合大众伦理的标准。

编辑点评:虽然无人驾驶技术的研制就是为了完全的规避交通事故的发生,但是在研制过程中难免遇到意外。而MIT希望通过算法,用自己的标准来为这个关于“救谁”的问题找到答案,虽然初衷很好,但作为一个伦理问题的角度,这个问题并没有一个真正的答案。